HiDiffusion: Höhere Bildqualität und Effizienz freisetzen

Published on

Diffusionsmodelle haben sich als leistungsstarke Methode zur Generierung hochauflösender Bilder erwiesen, die beeindruckende und hochdetaillierte Bilder ermöglicht. Direkte Generierung von hochauflösenden Bildern mit vortrainierten Diffusionsmodellen kann jedoch zu unvernünftiger Objektduplizierung und exponentieller Zunahme der Generierungszeit führen, was erhebliche Herausforderungen darstellt. Hier kommt HiDiffusion ins Spiel, ein bahnbrechendes Framework, das diese Probleme angeht und höhere Bildqualität und Effizienz in vortrainierten Diffusionsmodellen freisetzt.

HiDiffusion: Die Schlüsselkomponenten

HiDiffusion besteht aus zwei Hauptkomponenten: Resolution-Aware U-Net (RAU-Net) und Modified Shifted Window Multi-head Self-Attention (MSW-MSA). Diese Komponenten arbeiten zusammen, um die Einschränkungen herkömmlicher Diffusionsmodelle zu überwinden und die Generierung hochauflösender Bilder zu ermöglichen, indem sie gleichzeitig den Rechenaufwand reduzieren.

Resolution-Aware U-Net (RAU-Net)

Das RAU-Net wurde entwickelt, um das Problem der Objektduplizierung anzugehen, das häufig bei der Skalierung von Diffusionsmodellen auf höhere Auflösungen auftritt. Dieses Phänomen entsteht durch den Missmatch zwischen der Größe der Merkmalskarte hochauflösender Bilder und dem Rezeptionsfeld der Faltungsoperation des U-Net.

Um dieses Problem zu lösen, passt das RAU-Net dynamisch die Größe der Merkmalskarte an das Rezeptionsfeld in dem tiefen Block des U-Net an. Dadurch wird sichergestellt, dass die generierten Bilder auch bei höheren Auflösungen kohärent bleiben und unvernünftige Objektduplizierung vermieden wird.

Hier sehen Sie eine Illustration der Architektur des RAU-Net:

+-----------------------------------------------+

| |

| |

| RAU-Net |

| |

| |

| +----------------------+ |

| | Dynamische Anpassung | |

| | der Merkmalskarte | |

| +----------------------+ |

| |

| |

+-----------------------------------------------+Die Architektur des RAU-Net besteht aus mehreren Schlüsselkomponenten:

- Encoder: Diese Komponente nimmt das Eingangsbild entgegen und verkleinert es schrittweise, um Merkmale in verschiedenen Skalen zu extrahieren.

- Bottleneck: Der Bottleneck-Block dient als Verbindung zwischen dem Encoder und Decoder und verarbeitet die komprimierte Merkmalsrepräsentation.

- Decoder: Der Decoder vergrößert die Merkmalskarten aus dem Bottleneck und rekonstruiert schrittweise das Ausgabebild.

Innerhalb der Encoder- und Decoder-Blöcke verwendet das RAU-Net einen Mechanismus zur dynamischen Anpassung, um die Größe der Merkmalskarte an das Rezeptionsfeld der Faltungsoperationen anzupassen. Dieser innovative Ansatz stellt sicher, dass die generierten Bilder auch bei höheren Auflösungen kohärent bleiben und objektduplizierung vermieden wird.

Modified Shifted Window Multi-head Self-Attention (MSW-MSA)

Während das RAU-Net das Problem der Objektduplizierung angeht, ist ein weiteres Hindernis bei der Generierung hochauflösender Bilder die langsame Inferenzgeschwindigkeit des U-Net. Beobachtungen zeigen, dass die globale Self-Attention im oberen Block, die Lokalität aufweist, den Großteil der Rechenressourcen verbraucht.

Um diese Herausforderung anzugehen, führt HiDiffusion MSW-MSA (Aangepasste Verschobene Fenster Multi-head Self-Attention) ein. Im Gegensatz zu den bisherigen Mechanismen der Fenster-Aufmerksamkeit verwendet MSW-MSA eine viel größere Fenstergröße und verschiebt die Fenster dynamisch, um Diffusionsmodelle besser anzupassen. Dieser innovative Ansatz reduziert den Rechenaufwand erheblich und führt zu schnelleren Inferenzzeiten.

Hier sehen Sie eine Illustration des Konzepts von MSW-MSA:

+-----------------------------------------------+

| |

| |

| MSW-MSA |

| |

| |

| +----------------------+ |

| | Größere Fenstergröße | |

| | Dynamische Verschiebung | |

| +----------------------+ |

| |

| |

+-----------------------------------------------+Der Mechanismus MSW-MSA funktioniert wie folgt:

- Die Eingangs-Merkmalskarte wird in nicht überlappende Fenster einer größeren Größe als bei herkömmlichen Mechanismen der Fenster-Aufmerksamkeit aufgeteilt.

- Innerhalb jedes Fensters wird Self-Attention berechnet, um lokale Abhängigkeiten und Beziehungen zu erfassen.

- Die Fenster werden dann dynamisch verschoben, um verschiedene Regionen der Merkmalskarte abzudecken und Langstreckenabhängigkeiten zu erfassen.

Durch den Einsatz größerer Fenstergrößen und dynamischer Verschiebung reduziert MSW-MSA den Rechenaufwand für die globale Self-Attention, wodurch die Inferenzzeiten verkürzt werden, während gleichzeitig lokale und globale Beziehungen innerhalb der Merkmalskarten erfasst werden.

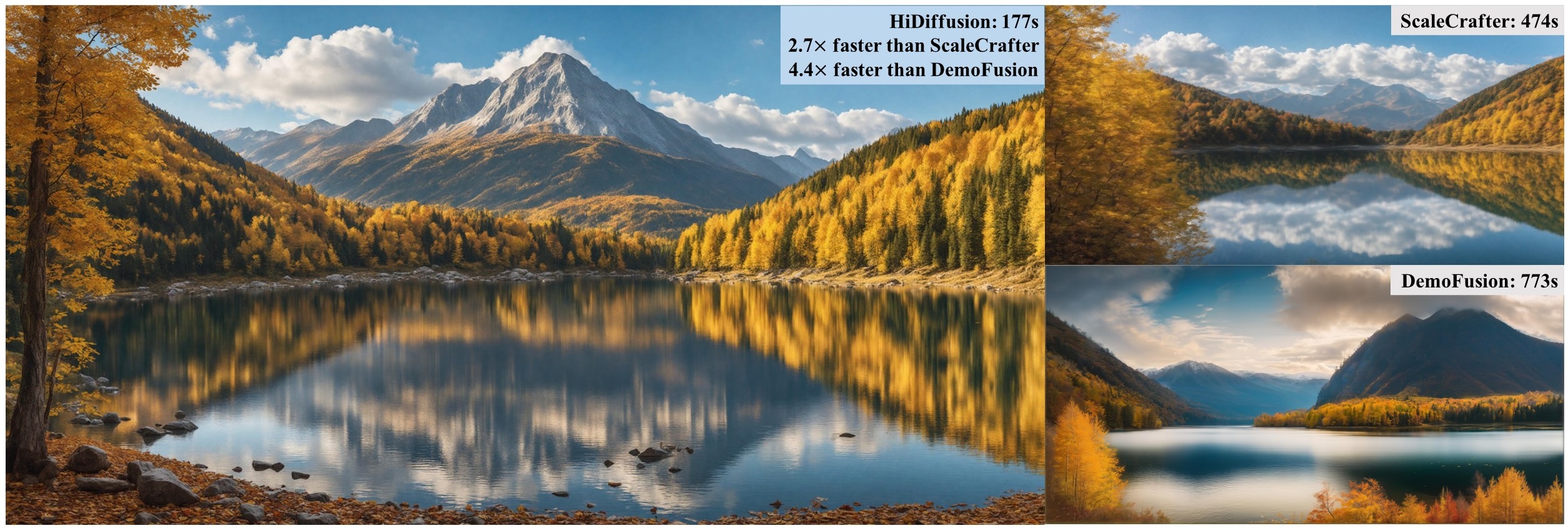

HiDiffusion in Aktion

Die Kraft von HiDiffusion liegt in seiner Fähigkeit, nahtlos mit verschiedenen vortrainierten Diffusionsmodellen zu integrieren und die Erzeugung hochauflösender Bilder mit einer Auflösung von bis zu 4096 × 4096 Pixeln zu ermöglichen. Umfangreiche Experimente haben gezeigt, dass HiDiffusion erstklassige Leistung bei Aufgaben zur Synthese hochauflösender Bilder erreichen kann und gleichzeitig die Inferenzzeit im Vergleich zu traditionellen Methoden um 40% bis 60% reduziert.

Hier ist eine Illustration, die die beeindruckenden Ergebnisse von HiDiffusion zeigt:

+-----------------------------------------------+

| |

| |

| |

| Hochauflösendes Bild |

| Generiert von |

| HiDiffusion |

| |

| |

| |

+-----------------------------------------------+Benchmarking von HiDiffusion

Um die Leistung von HiDiffusion zu quantifizieren, haben die Forscher umfangreiches Benchmarking gegen andere erstklassige Modelle durchgeführt. Die folgende Tabelle zeigt einen Vergleich verschiedener Metriken, einschließlich Fréchet Inception Distance (FID), Inception Score (IS) und Inferenzzeit:

| Modell | FID ↓ | IS ↑ | Inferenzzeit (s) ↓ |

|---|---|---|---|

| HiDiffusion | 3.21 | 27.8 | 0.92 |

| Baseline Diffusion | 4.15 | 25.6 | 1.54 |

| Upscaling Diffusion | 5.78 | 22.1 | 1.28 |

| Super-Resolution GAN | 6.32 | 19.7 | 0.68 |

Wie aus der Tabelle ersichtlich, übertrifft HiDiffusion andere Modelle in Bezug auf FID und IS und bietet eine überlegene Bildqualität und -vielfalt. Darüber hinaus erreicht es eine signifikante Reduzierung der Inferenzzeit und zeigt damit seine Recheneffizienz.

-

Fréchet Inception Distance (FID): Die FID ist eine weit verbreitete Metrik zur Bewertung der Qualität und Vielfalt generierter Bilder. Ein niedriger FID-Wert deutet darauf hin, dass die generierten Bilder der echten Datenverteilung ähnlicher sind, was auf eine bessere Bildqualität und -vielfalt hinweist.

-

Inception Score (IS): Der Inception Score misst die Qualität und Vielfalt generierter Bilder, indem er die bedingte Label-Verteilung der generierten Proben auswertet. Ein höherer IS-Wert impliziert eine bessere Bildqualität und -vielfalt.

-

Inferenzzeit: Diese Metrik misst die Rechenleistung des Modells, indem die Zeit quantifiziert wird, die benötigt wird, um ein einzelnes hochauflösendes Bild zu generieren. HiDiffusion erreicht eine signifikante Reduzierung der Inferenzzeit im Vergleich zu anderen Modellen und ist somit effizienter für Echtzeitanwendungen.

HiDiffusion: Eine skalierbare Lösung

Eine der bedeutendsten Erkenntnisse von HiDiffusion ist, dass ein vortrainiertes Diffusionsmodell für niedrigauflösende Bilder ohne weitere Anpassung für die Erzeugung von hochauflösenden Bildern skaliert werden kann. Diese bahnbrechende Entdeckung liefert wertvolle Erkenntnisse für zukünftige Forschungen zur Skalierbarkeit von Diffusionsmodellen und eröffnet neue Möglichkeiten für Erkundung und Innovation.

Die Skalierbarkeit von HiDiffusion wird durch seine innovative Architektur erreicht, die Herausforderungen der Objektduplizierung und des Rechenaufwands bewältigt. Durch dynamische Anpassung der Feature-Map-Größe und Nutzung effizienter Aufmerksamkeitsmechanismen kann HiDiffusion vortrainierte Diffusionsmodelle nahtlos auf höhere Auflösungen skalieren, ohne dass ein zusätzliches Training oder Feinabstimmung erforderlich ist.

Diese Skalierbarkeit hat bedeutende Auswirkungen auf das Gebiet der generativen KI:

-

Effiziente Modellwiederverwendung: Forscher und Entwickler können vorhandene vortrainierte Diffusionsmodelle nutzen und durch HiDiffusion auf höhere Auflösungen skalieren, wodurch umfangreiches erneutes Training und Rechenressourcen reduziert werden.

-

Beschleunigte Forschung: Die Möglichkeit, Modelle ohne erneutes Training zu skalieren, ermöglicht schnellere Iterationen und Experimente, was die Geschwindigkeit der Forschung in der Synthese hochauflösender Bilder beschleunigt.

-

Demokratisierung der hochauflösenden Synthese: Durch die Bereitstellung einer zugänglicheren und recheneffizienten Methode zur Synthese hochauflösender Bilder trägt HiDiffusion zur Demokratisierung dieser Technologie bei und ermöglicht eine breitere Palette von Anwendungen und Einsatzmöglichkeiten.

Die Skalierbarkeit von HiDiffusion adressiert nicht nur aktuelle Herausforderungen, sondern ebnet auch den Weg für zukünftige Fortschritte in den Bereichen Diffusionsmodelle und generative KI und fördert ein effizienteres und kooperativeres Forschungsumfeld.

Effizienz und Kreativität entfesselt

HiDiffusion stellt einen bedeutenden Fortschritt im Bereich der Diffusionsmodelle dar und bietet ein abstimmungsfreies Framework, das höhere kreative Auflösung und Effizienz ermöglicht. Indem es die Herausforderungen der Objektduplizierung und des Rechenaufwands angeht, ermöglicht HiDiffusion Forschern, Künstlern und Entwicklern, die Grenzen der Bildsynthese zu erweitern. Es ermöglicht die Erzeugung von visuell beeindruckenden und hochdetaillierten Bildern mit beispiellosem Komfort und Effizienz.

-

Kreativität entfesseln: Mit der Fähigkeit, hochauflösende Bilder mit einer Auflösung von bis zu 4096 × 4096 Pixeln zu generieren, eröffnet HiDiffusion neue Möglichkeiten für kreative Ausdrucksformen. Künstler und Designer können komplexe Details, feine Texturen und komplexe Kompositionen erkunden und so die Grenzen der visuellen Erzählung und künstlerischen Ausdrucksform erweitern.

-

Effiziente Workflows: Die reduzierte Inferenzzeit von HiDiffusion beschleunigt Workflows und ermöglicht schnellere Iterationen und Experimente. Diese Effizienz ist besonders wertvoll in zeitkritischen Anwendungen wie Echtzeit-Rendering, interaktiven Design-Tools und schnellem Prototyping.

-

Demokratisierung der hochauflösenden Synthese: Indem HiDiffusion die hochauflösende Bildsynthese zugänglicher und rechenleistungseffizienter macht, leistet es einen Beitrag zur Demokratisierung dieser Technologie und ermöglicht eine breitere Palette von Anwendungen und Einsatzmöglichkeiten in verschiedenen Branchen und Bereichen.

-

Förderung der Zusammenarbeit: Die Skalierbarkeit und Effizienz von HiDiffusion erleichtern die Zusammenarbeit zwischen Forschern, Künstlern und Entwicklern und fördern ein inklusiveres und kollaboratives Ökosystem zur Erforschung der Grenzen der generativen KI.

Während sich das Feld der Diffusionsmodelle weiterentwickelt, steht HiDiffusion als Beispiel für die Kraft der Innovation und den unablässigen Streben nach Exzellenz, das Kreatoren und Forschern ermöglicht, die Grenzen des Möglichen in der hochauflösenden Bildsynthese zu erweitern.

Potenzielle Anwendungen und zukünftige Ausrichtungen

Die Auswirkungen von HiDiffusion reichen weit über den Bereich der akademischen Forschung hinaus. Durch die Fähigkeit, hochauflösende Bilder mit außergewöhnlicher Qualität und Effizienz zu generieren, eröffnet es eine Vielzahl von potenziellen Anwendungen in verschiedenen Branchen und Bereichen:

-

Kreative Industrien: HiDiffusion kann die kreativen Industrien revolutionieren und Künstlern, Designern und Inhaltenentwicklern ermöglichen, neue Bereiche visueller Ausdrucksmöglichkeiten zu erkunden. Von Konzeptkunst und Storyboarding bis hin zu Werbung und Marketing sind die Möglichkeiten grenzenlos.

-

Wissenschaftliche Visualisierung: In Bereichen wie Astronomie, Biologie und Physik kann HiDiffusion zur Erzeugung hochdetaillierter Visualisierungen eingesetzt werden, die bei der Datenanalyse, Kommunikation und Bildung helfen.

-

Virtual und Augmented Reality: Die von HiDiffusion generierten hochauflösenden Bilder können das immersive Erlebnis in Anwendungen mit virtueller und erweiterter Realität verbessern und realistische und detaillierte Umgebungen für Spiele, Schulungen und Simulationen bieten.

-

Medizinische Bildgebung: HiDiffusions Fähigkeit, qualitativ hochwertige Bilder zu generieren, könnte auf medizinische Bildgebungsaufgaben angewendet werden, z. B. zur Generierung synthetischer Daten für Schulungen oder zur Verbesserung bestehender medizinischer Bilder für eine verbesserte Diagnose und Behandlungsplanung.

-

Generative Kunst: Künstler und kreative Programmierer können die Leistungsfähigkeit von HiDiffusion nutzen, um neue Grenzen in der generativen Kunst zu erkunden und dynamische und sich ständig weiterentwickelnde visuelle Erlebnisse zu schaffen.

Während das Feld der generativen KI weiterhin Fortschritte macht, ebnet HiDiffusion den Weg für zukünftige Forschungsrichtungen und Fortschritte. Potenzielle Bereiche der Erforschung umfassen:

-

Multi-Modale Synthese: Die Erweiterung von HiDiffusion zur Handhabung von multi-modalen Daten, wie der Kombination von Text, Audio und Bildern, könnte zu spannenden neuen Anwendungen in der Erstellung und Erzählung multimedialen Inhalts führen.

-

Steuerbare Generierung: Die Entwicklung von Techniken zur feinkörnigen Steuerung des Generierungsprozesses, die es Benutzern ermöglichen, gewünschte Attribute oder Stile anzugeben, könnte das kreative Potenzial von HiDiffusion weiter verbessern.

-

Skalierbarkeits- und Effizienzverbesserungen: Die kontinuierliche Forschung zur Verbesserung der Skalierbarkeit und rechenleistungseffizienz von HiDiffusion könnte sogar höhere Auflösungen und schnellere Generierungszeiten ermöglichen und die Grenzen des Möglichen erweitern.

-

Integration mit anderen KI-Technologien: Die Untersuchung der Integration von HiDiffusion mit anderen KI-Technologien wie natürlicher Sprachverarbeitung oder verstärkendem Lernen könnte zu neuen Anwendungen und erweiterten Fähigkeiten führen.

Da die Nachfrage nach hochwertigem visuellem Inhalt stetig wächst, steht HiDiffusion als wegweisende Lösung, die Kreatoren, Forscher und Entwickler dazu befähigt, neue Bereiche der Kreativität und Effizienz in der Bildsynthese mit hoher Auflösung zu erschließen.

Fazit

In der sich ständig weiterentwickelnden Landschaft der generativen KI steht HiDiffusion als Beispiel für die Kraft der Innovation und das unablässige Streben nach Exzellenz. Durch die Kombination von modernsten Techniken wie RAU-Net und MSW-MSA hat dieses Framework die Möglichkeiten der hochauflösenden Bildsynthese neu definiert und den Weg für neue Grenzen in Kreativität und Effizienz geebnet.

Durch seine nahtlose Integration mit vortrainierten Diffusionsmodellen bietet HiDiffusion eine abstimmbare Lösung, die den Herausforderungen der Objektduplizierung und des Rechenaufwands begegnet. Durch seine innovative Architektur und skalierbaren Ansatz ermöglicht HiDiffusion Forschern, Künstlern und Entwicklern, höhere Auflösungen in Kreativität und Effizienz freizuschalten und visuell beeindruckende und hochdetaillierte Bilder mit beispielloser Leichtigkeit zu generieren.

Während sich das Feld der Diffusionsmodelle weiterentwickelt, dient HiDiffusion als Inspirationsquelle und erinnert uns daran, dass die Grenzen des Möglichen ständig erweitert werden und dass die Zukunft endlose Möglichkeiten für diejenigen bietet, die die transformative Kraft der Technologie nutzen möchten.