Prompts de Cadena de Pensamiento: Desbloquea el Poder de LLMs con Ejemplos

Published on

¡Bienvenido a esta guía exhaustiva sobre los Prompts de Cadena de Pensamiento! Si alguna vez te has preguntado cómo mejorar las capacidades de razonamiento de los modelos de lenguaje grandes, estás en el lugar correcto. Esta técnica está revolucionando el campo del aprendizaje automático y el procesamiento del lenguaje natural.

En este artículo, profundizaremos en qué es el Prompt de Cadena de Pensamiento, cómo funciona, sus numerosos beneficios y sus aplicaciones prácticas. También exploraremos cómo se aplica esta técnica en varios contextos como Langchain, ChatGPT y Python. ¡Así que empecemos!

¿Qué es el Prompt de Cadena de Pensamiento?

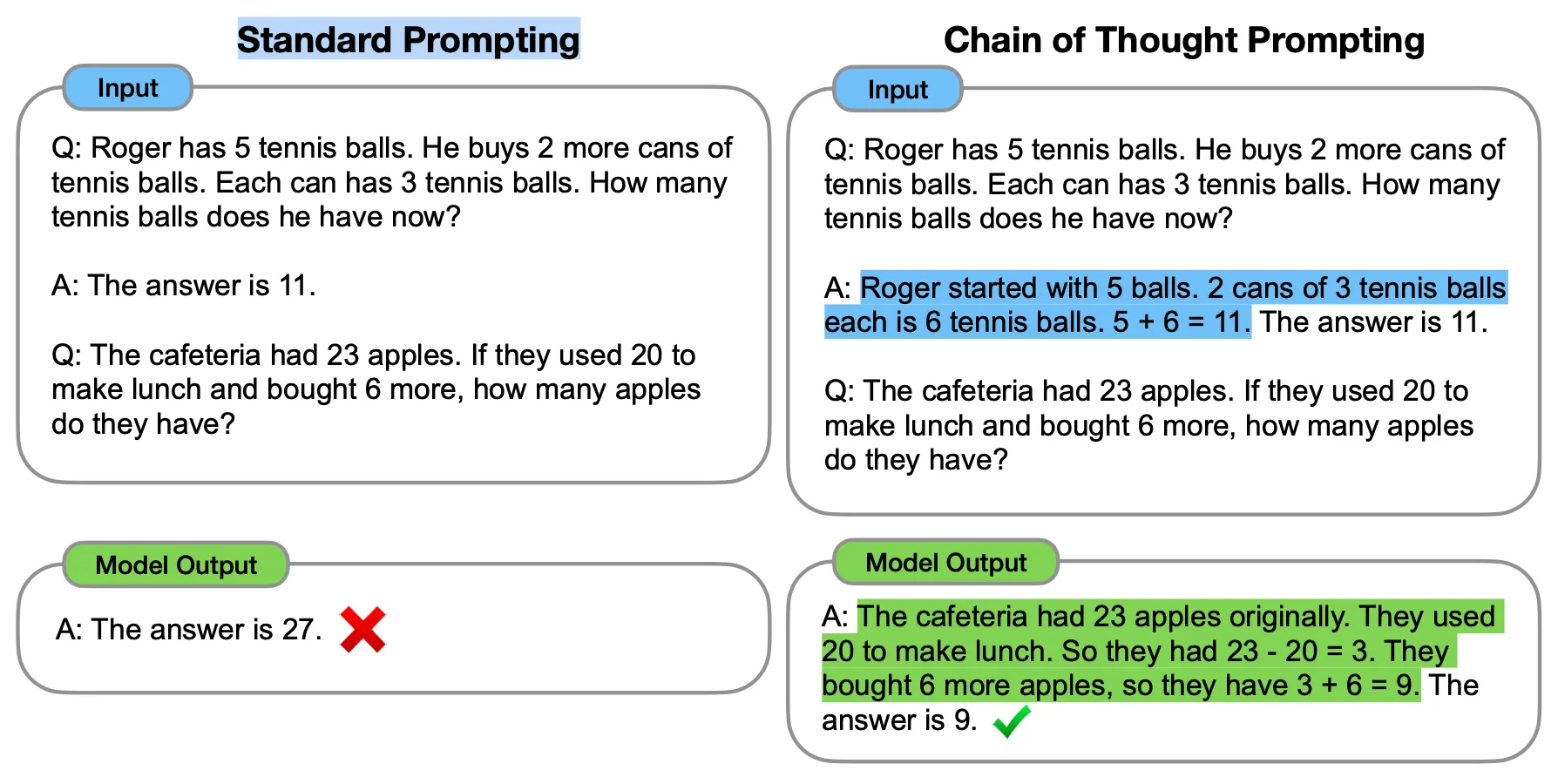

El Prompt de Cadena de Pensamiento es una técnica que alienta a los Modelos de Lenguaje Grandes (LLMs) a pensar de manera lógica y secuencial. A diferencia de los métodos de prompt tradicionales, CoT hace que el modelo evalúe su razonamiento en cada etapa, lo que le permite cambiar a métodos alternativos si ocurre un error. Esto resulta en salidas más precisas y confiables.

¿Cómo funciona?

La idea principal es proporcionar al LLM una serie de prompts que guíen su proceso de pensamiento. Cada prompt sirve como un "nodo de pensamiento" y el modelo debe evaluar la salida de cada nodo antes de pasar al siguiente. De esta manera, el modelo puede corregirse si se desvía del rumbo.

Implementar el Prompt de Cadena de Pensamiento es como construir un mapa para tu modelo de lenguaje. Así es como se hace:

- Identifica el Problema: Definir claramente el problema de varios pasos que deseas que el modelo de lenguaje resuelva.

- Divídelo en Pasos: Descomponer el problema en tareas o preguntas más pequeñas que conduzcan a la solución final.

- Crea Prompts: Para cada tarea más pequeña, crea un prompt que guíe al modelo de lenguaje.

- Ejecuta: Alimenta estos prompts al modelo de lenguaje en una secuencia, recolectando las salidas en cada paso.

- Analiza y Refina: Evalúa las salidas y refina los prompts si es necesario.

Ejemplo: Digamos que quieres resolver un problema matemático sobre cómo calcular la velocidad promedio de un automóvil en un viaje. En lugar de pedirle al modelo que lo resuelva directamente, podrías dividirlo en pasos:

- Calcula la distancia total recorrida.

- Calcula el tiempo total transcurrido.

- Calcula la velocidad promedio usando la fórmula:

Velocidad Promedio = Distancia Total / Tiempo Total

Beneficios de Usar el Prompt de Cadena de Pensamiento

Razonamiento y Resolución de Problemas Mejorados

Una de las ventajas más convincentes del Prompt de Cadena de Pensamiento es su capacidad para mejorar significativamente las capacidades de razonamiento de los modelos de lenguaje grandes. Los modelos de lenguaje tradicionales a menudo se quedan estancados al enfrentarse a tareas de razonamiento de varios pasos o complejas. CoT demuele eficazmente esta barrera.

- Precisión: Al descomponer un problema en tareas más pequeñas, el modelo puede enfocarse en cada paso, lo que lleva a resultados más precisos.

- Tareas Complejas: Ya sea resolver problemas matemáticos o comprender escenarios complicados, CoT capacita a los modelos de lenguaje para manejarlos de manera eficiente.

El Prompt de Cadena de Pensamiento en ChatGPT

Ejemplos de Prompt de Cadena de Pensamiento

El Prompt de Cadena de Pensamiento, o CoT, es una técnica de vanguardia diseñada para hacer que los Modelos de Lenguaje Grandes (LLMs) como ChatGPT sean más articulados en su razonamiento. A diferencia de los métodos de prompt tradicionales, CoT utiliza una serie de "ejemplos de pocos disparos" que guían al modelo a través de una secuencia lógica de pasos. Esto resulta en salidas más precisas y confiables.

La idea principal detrás de CoT es usar estos ejemplos de pocos disparos para mostrar explícitamente el proceso de razonamiento. Cuando se le indica al modelo de esta manera, también revela los pasos de su razonamiento, lo que lleva a respuestas más precisas e informativas.

Referencias del Prompt de Cadena de Pensamiento

Por ejemplo, se probó GPT-3 (davinci-003) con un problema de palabras simple. Inicialmente, usando un prompt tradicional, no pudo resolver el problema. Sin embargo, cuando se aplicó el prompt de CoT, el modelo logró resolver el mismo problema con éxito. Esto demuestra la efectividad de CoT al mejorar las habilidades de resolución de problemas del modelo.

CoT ha demostrado ser muy efectivo al mejorar el rendimiento de LLMs en diversas tareas, incluyendo aritmética, razonamiento del sentido común y razonamiento simbólico. Específicamente, los modelos con prompt de CoT han logrado una precisión del 57% en la resolución de problemas en la prueba GSM8K, que era considerada la mejor en ese momento.

!Referencias del Prompt de Cadena de Pensamiento](https://raw.githubusercontent.com/lynn-mikami/Images/main/chain-of-thought-prompting-chatgpt-3.webp (opens in a new tab))

Vale la pena mencionar que CoT es más efectivo cuando se utiliza con modelos más grandes, específicamente aquellos con alrededor de 100 mil millones de parámetros. Los modelos más pequeños tienden a producir cadenas de pensamiento ilógicas, lo que puede afectar negativamente la precisión. Por lo tanto, las mejoras en el rendimiento de CoT generalmente son proporcionales al tamaño del modelo.

El Prompt de Cadena de Pensamiento en LangChain

Así es como Langchain utiliza CoT en Python:

from langchain.chains import SequentialChain

# Define las cadenas

chain1 = ...

chain2 = ...

chain3 = ...

chain4 = ...

# Conecta las cadenas

overall_chain = SequentialChain(chains=[chain1, chain2, chain3, chain4], input_variables=["input", "perfect_factors"], output_variables=["ranked_solutions"], verbose=True)

# Ejecuta la cadena generalprint(overall_chain({"input": "colonización humana de Marte", "perfect_factors": "La distancia entre la Tierra y Marte es muy grande, lo que dificulta el suministro regular"}))Este fragmento de código muestra cómo Langchain conecta múltiples cadenas utilizando la clase SequentialChain. La salida de una cadena se convierte en la entrada de la siguiente, lo que permite una cadena de pensamiento compleja.

Conclusión

Resumen de los puntos clave

Hemos explorado el fascinante mundo de las Cadenas de Pensamiento (Chain of Thought Prompting, CoT), una técnica que está revolucionando la forma en que los Modelos de Lenguaje Grande (Large Language Models, LLM) como ChatGPT y Langchain operan. A diferencia de los métodos de solicitud tradicionales, CoT guía al modelo a través de una secuencia lógica de pasos, mejorando su razonamiento y capacidad de resolución de problemas. Esto resulta en salidas más precisas y confiables, especialmente en tareas que requieren razonamiento complejo.

Por qué CoT es un cambio de juego

CoT es más que una nueva técnica; es un cambio de juego en el campo del aprendizaje automático y el procesamiento del lenguaje natural. Al hacer que los modelos sean más elocuentes en su razonamiento, CoT abre nuevas posibilidades para aplicaciones que requieren resolución de problemas complejos y razonamiento lógico. Ya sea en tareas de aritmética, razonamiento de sentido común o razonamiento simbólico, CoT ha demostrado mejorar significativamente las métricas de rendimiento.

Preguntas frecuentes

¿Qué es la cadena de pensamiento en Langchain?

En Langchain, la Cadena de Pensamiento (Chain of Thought Prompting) se implementa a través de un algoritmo de Árbol de Pensamientos (Tree of Thoughts, ToT) que combina LLMs y búsqueda heurística. Esto permite que la plataforma maneje tareas de lenguaje más complejas al guiar al modelo a través de una serie de pasos lógicos.

¿Cuál es la estrategia de la cadena de pensamiento?

La estrategia de la cadena de pensamiento es un método para guiar el proceso de razonamiento de un modelo a través de una serie de pasos lógicos o "nodos de pensamiento". Cada nodo sirve como una solicitud que el modelo debe evaluar antes de pasar al siguiente, lo que le permite corregirse si se desvía del camino correcto.

¿Cuál es un ejemplo de una cadena de pensamientos?

Un ejemplo de una cadena de pensamientos sería descomponer un problema matemático complejo en tareas más pequeñas y resolverlas paso a paso. Por ejemplo, si el problema es encontrar el área de un trapecio, la cadena de pensamientos podría incluir calcular el promedio de los dos lados paralelos, luego encontrar la altura y, finalmente, multiplicarlos para obtener el área.