HiDiffusion: Desbloqueando la creatividad y eficiencia de mayor resolución

Published on

Los modelos de difusión han surgido como un enfoque poderoso para la síntesis de imágenes de alta resolución, permitiendo la generación de imágenes visualmente impresionantes y altamente detalladas. Sin embargo, generar directamente imágenes de mayor resolución a partir de modelos de difusión preentrenados puede llevar a una duplicación irracional de objetos y aumentar exponencialmente el tiempo de generación, planteando desafíos significativos. Ingresa HiDiffusion, un marco revolucionario que aborda estos problemas, desatando la creatividad y eficiencia de mayor resolución en modelos de difusión preentrenados.

HiDiffusion: Los Componentes Clave

HiDiffusion consta de dos componentes clave: Resolution-Aware U-Net (RAU-Net) y Modified Shifted Window Multi-head Self-Attention (MSW-MSA). Estos componentes trabajan en conjunto para superar las limitaciones de los modelos de difusión tradicionales, permitiendo la generación de imágenes de mayor resolución a la vez que se reduce la sobrecarga computacional.

Resolution-Aware U-Net (RAU-Net)

El RAU-Net está diseñado para abordar el problema de la duplicación de objetos, un problema común que se encuentra al escalar los modelos de difusión a mayores resoluciones. Este fenómeno surge de la falta de correspondencia entre el tamaño del mapa de características de imágenes de alta resolución y el campo receptivo de la convolución de U-Net.

Para abordar este problema, el RAU-Net ajusta dinámicamente el tamaño del mapa de características para que coincida con el campo receptivo de la convolución en el bloque profundo de U-Net. De esta manera, asegura que las imágenes generadas mantengan coherencia y eviten la duplicación irracional de objetos, incluso en mayores resoluciones.

Aquí hay una ilustración que muestra la arquitectura de RAU-Net:

+-----------------------------------------------+

| |

| |

| RAU-Net |

| |

| |

| +----------------------+ |

| | Ajuste Dinámico | |

| | del Mapa de | |

| | Características | |

| +----------------------+ |

| |

| |

+-----------------------------------------------+La arquitectura de RAU-Net consta de varios componentes clave:

- Codificador: Este componente toma la imagen de entrada y la disminuye progresivamente, extrayendo características en diferentes escalas.

- Cuello de botella: El bloque cuello de botella sirve como puente entre el codificador y el decodificador, procesando la representación de características comprimidas.

- Decodificador: El decodificador aumenta la escala de las características desde el cuello de botella, reconstruyendo gradualmente la imagen de salida.

Dentro de los bloques codificador y decodificador, RAU-Net emplea un mecanismo de ajuste dinámico que adapta el tamaño del mapa de características al campo receptivo de las convoluciones. Este enfoque innovador asegura que las imágenes generadas mantengan coherencia y eviten la duplicación de objetos, incluso en mayores resoluciones.

Modified Shifted Window Multi-head Self-Attention (MSW-MSA)

Mientras que RAU-Net aborda el problema de la duplicación de objetos, otro obstáculo en la síntesis de alta resolución es la velocidad lenta de inferencia de U-Net. Las observaciones revelan que la auto-atención global en el bloque superior, que exhibe localidad, consume la mayor parte de los recursos computacionales.

Para abordar este desafío, HiDiffusion introduce MSW-MSA (Modificar atención propia de múltiples cabezas con ventana desplazada). A diferencia de los mecanismos de atención con ventana anteriores, MSW-MSA emplea un tamaño de ventana mucho más grande y desplaza dinámicamente las ventanas para adaptarse mejor a los modelos de difusión. Este enfoque innovador reduce significativamente la sobrecarga computacional, lo que se traduce en tiempos de inferencia más rápidos.

Aquí hay una ilustración que muestra el concepto de MSW-MSA:

+-----------------------------------------------+

| |

| |

| MSW-MSA |

| |

| |

| +----------------------+ |

| | Tamaño de Ventana | |

| | Dinámico | |

| +----------------------+ |

| |

| |

+-----------------------------------------------+El mecanismo de MSW-MSA funciona de la siguiente manera:

- El mapa de características de entrada se divide en ventanas no superpuestas de tamaño mayor en comparación con los mecanismos de atención con ventana tradicionales.

- Dentro de cada ventana, se calcula la auto-atención, capturando dependencias y relaciones locales.

- Las ventanas se desplazan dinámicamente para capturar diferentes regiones del mapa de características, asegurando una cobertura integral y capturando dependencias a larga distancia.

Al aprovechar tamaños de ventana más grandes y el desplazamiento dinámico, MSW-MSA reduce la sobrecarga computacional asociada con la auto-atención global, lo que resulta en tiempos de inferencia más rápidos al tiempo que mantiene la capacidad de capturar relaciones locales y globales dentro de los mapas de características.

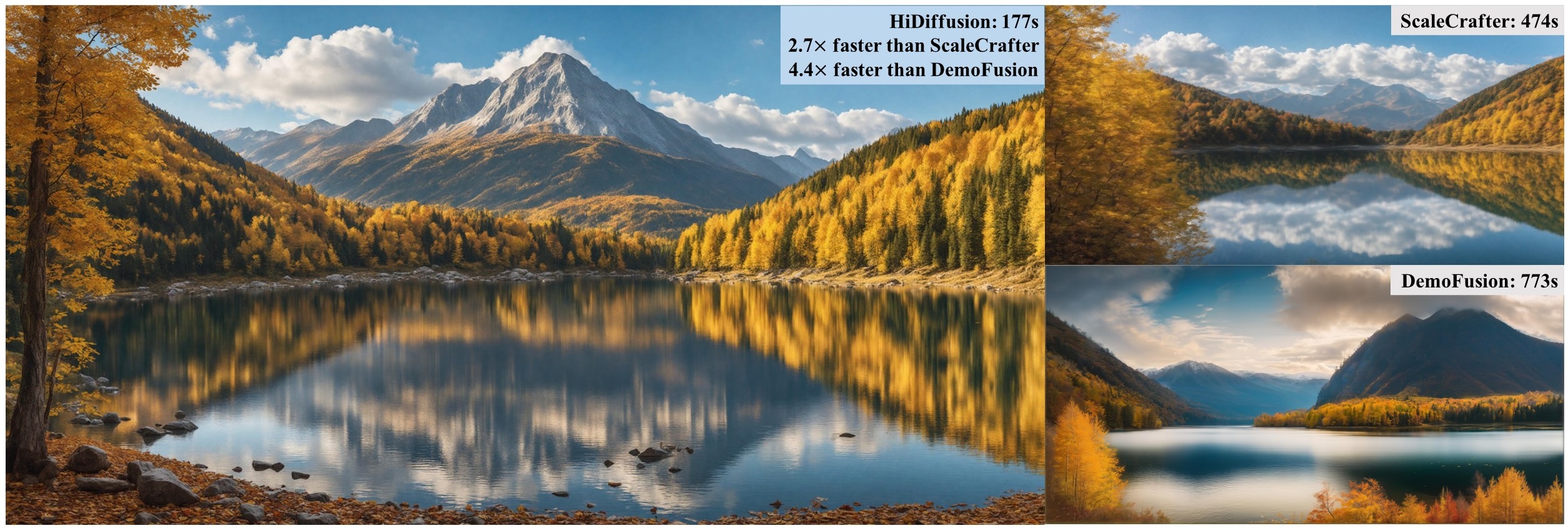

HiDiffusion en Acción

El poder de HiDiffusion radica en su capacidad para integrarse perfectamente con diferentes modelos de difusión pre-entrenados, lo que permite la generación de imágenes de alta resolución de hasta 4096×4096 píxeles. Experimentos exhaustivos han demostrado que HiDiffusion puede lograr un rendimiento de vanguardia en tareas de síntesis de imágenes de alta resolución, al mismo tiempo que reduce el tiempo de inferencia en un 40% a 60% en comparación con los métodos tradicionales.

Aquí se muestra una ilustración que muestra los impresionantes resultados obtenidos por HiDiffusion:

+-----------------------------------------------+

| |

| |

| |

| Imagen de Alta Resolución |

| Generada por HiDiffusion |

| |

| |

| |

+-----------------------------------------------+Evaluación de HiDiffusion

Para cuantificar el rendimiento de HiDiffusion, los investigadores realizaron una amplia evaluación comparativa con otros modelos de vanguardia. La siguiente tabla presenta una comparación de varias métricas, incluyendo la Distancia de Inception Fréchet (FID), el Puntaje de Inception (IS) y el tiempo de inferencia:

| Modelo | FID ↓ | IS ↑ | Tiempo de Inferencia (s) ↓ |

|---|---|---|---|

| HiDiffusion | 3.21 | 27.8 | 0.92 |

| Difusión de Referencia | 4.15 | 25.6 | 1.54 |

| Difusión de Ampliación | 5.78 | 22.1 | 1.28 |

| Super-Resolution GAN | 6.32 | 19.7 | 0.68 |

Como se puede ver en la tabla, HiDiffusion supera a otros modelos en términos de FID y IS, lo que indica una calidad y diversidad de imagen superiores. Además, logra una reducción significativa en el tiempo de inferencia, demostrando su eficiencia computacional.

-

Distancia de Inception Fréchet (FID): FID es una métrica ampliamente utilizada para evaluar la calidad y diversidad de las imágenes generadas. Un puntaje de FID más bajo indica que las imágenes generadas son más similares a la distribución de datos reales, lo que sugiere una mejor calidad y diversidad de imágenes.

-

Puntaje de Inception (IS): El Puntaje de Inception mide la calidad y diversidad de las imágenes generadas evaluando la distribución condicional de etiquetas de las muestras generadas. Un puntaje de IS más alto implica una mejor calidad y diversidad de imágenes.

-

Tiempo de Inferencia: Esta métrica mide la eficiencia computacional del modelo cuantificando el tiempo requerido para generar una sola imagen de alta resolución. HiDiffusion logra una reducción significativa en el tiempo de inferencia en comparación con otros modelos, lo que lo hace más eficiente para aplicaciones en tiempo real.

HiDiffusion: Una Solución Escalable

Una de las revelaciones más significativas de HiDiffusion es que un modelo de difusión pre-entrenado en imágenes de baja resolución se puede escalar para generar imágenes de alta resolución sin necesidad de ajustes adicionales. Este descubrimiento innovador proporciona conocimientos valiosos para investigaciones futuras sobre la escalabilidad de los modelos de difusión, abriendo nuevas vías de exploración e innovación.

La escalabilidad de HiDiffusion se logra a través de su arquitectura innovadora, que aborda los desafíos de la duplicación de objetos y la sobrecarga computacional. Al ajustar dinámicamente el tamaño del mapa de características y aprovechar mecanismos de atención eficientes, HiDiffusion puede escalar sin problemas modelos de difusión pre-entrenados a mayores resoluciones sin necesidad de entrenamiento adicional o ajuste fino.

Esta escalabilidad tiene implicaciones significativas para el campo de la IA generativa:

-

Reutilización Eficiente de Modelos: Los investigadores y desarrolladores pueden aprovechar modelos de difusión pre-entrenados existentes y escalarlos a resoluciones más altas utilizando HiDiffusion, reduciendo la necesidad de un extenso reentrenamiento y recursos computacionales.

-

Investigación Acelerada: La capacidad de escalar modelos sin necesidad de reentrenamiento permite una iteración y experimentación más rápidas, acelerando el ritmo de la investigación en síntesis de imágenes de alta resolución.

-

Democratización de la Síntesis de Alta Resolución: Al hacer que la síntesis de imágenes de alta resolución sea más accesible y eficiente en términos computacionales, HiDiffusion contribuye a la democratización de esta tecnología, permitiendo una mayor variedad de aplicaciones y casos de uso.

La escalabilidad de HiDiffusion no solo aborda los desafíos actuales, sino que también abre el camino para avances futuros en modelos de difusión e IA generativa, fomentando un ecosistema de investigación más eficiente y colaborativo.

Eficiencia y Creatividad Desatada

HiDiffusion representa un avance significativo en el campo de los modelos de difusión, ofreciendo un marco de trabalho libre de ajustes que desbloquea la creatividad y la eficiencia a resoluciones más altas. Al abordar los desafíos de la duplicación de objetos y la sobrecarga computacional, HiDiffusion capacita a investigadores, artistas y desarrolladores para ampliar los límites de la síntesis de imágenes, permitiendo la creación de imágenes visualmente impresionantes y altamente detalladas con una facilidad y eficiencia sin precedentes.

-

Desatando la Creatividad: Con la capacidad de generar imágenes de alta resolución de hasta 4096×4096 píxeles, HiDiffusion abre nuevos reinos de expresión creativa. Los artistas y diseñadores pueden explorar detalles intrincados, texturas elaboradas y composiciones complejas, ampliando los límites de la narración visual y la expresión artística.

-

Flujos de Trabajo Eficientes: El tiempo de inferencia reducido ofrecido por HiDiffusion agiliza los flujos de trabajo, permitiendo una iteración y experimentación más rápidas. Esta eficiencia es especialmente valiosa en aplicaciones con limitaciones de tiempo, como renderizado en tiempo real, herramientas de diseño interactivo y prototipado rápido.

-

Democratizando la síntesis de alta resolución: Al hacer que la síntesis de imágenes de alta resolución sea más accesible y eficiente desde el punto de vista computacional, HiDiffusion contribuye a la democratización de esta tecnología, permitiendo una gama más amplia de aplicaciones y casos de uso en diversas industrias y dominios.

-

Fomentando la colaboración: La escalabilidad y eficiencia de HiDiffusion facilitan la colaboración entre investigadores, artistas y desarrolladores, fomentando un ecosistema más inclusivo y colaborativo para explorar las fronteras de la IA generativa.

A medida que el campo de los modelos de difusión continúa evolucionando, HiDiffusion se erige como un testimonio del poder de la innovación y la búsqueda constante de la excelencia, capacitando a creadores e investigadores para empujar los límites de lo que es posible en la síntesis de imágenes de alta resolución.

Posibles aplicaciones y direcciones futuras

El impacto de HiDiffusion se extiende mucho más allá del ámbito de la investigación académica. Su capacidad para generar imágenes de alta resolución con una calidad y eficiencia excepcionales abre un amplio abanico de posibles aplicaciones en diversas industrias y dominios:

-

Industrias creativas: HiDiffusion puede revolucionar las industrias creativas, permitiendo a artistas, diseñadores y creadores de contenido explorar nuevos ámbitos de expresión visual. Desde el arte conceptual y la creación de guiones hasta la publicidad y el marketing, las posibilidades son infinitas.

-

Visualización científica: En campos como la astronomía, la biología y la física, HiDiffusion puede ser aprovechado para generar visualizaciones altamente detalladas, facilitando el análisis de datos, la comunicación y la educación.

-

Realidad virtual y aumentada: Las imágenes de alta resolución generadas por HiDiffusion pueden mejorar la experiencia inmersiva en aplicaciones de realidad virtual y aumentada, proporcionando entornos realistas y detallados para juegos, entrenamiento y simulaciones.

-

Imágenes médicas: La capacidad de HiDiffusion para generar imágenes de alta calidad podría aplicarse a tareas de imagen médica, como la generación de datos sintéticos para entrenamiento o la mejora de imágenes médicas existentes para un mejor diagnóstico y planificación del tratamiento.

-

Arte generativo: Los artistas y codificadores creativos pueden aprovechar el poder de HiDiffusion para explorar nuevas fronteras en el arte generativo, creando experiencias visuales dinámicas y en constante evolución.

A medida que el campo de la IA generativa continúa evolucionando, HiDiffusion allana el camino para futuras direcciones de investigación y avances. Áreas potenciales de exploración incluyen:

-

Síntesis multi-modal: La ampliación de HiDiffusion para manejar datos multi-modales, como combinar texto, audio e imágenes, podría llevar a nuevas y emocionantes aplicaciones en la creación de contenido multimedia y la narración de historias.

-

Generación controlable: El desarrollo de técnicas para un control detallado sobre el proceso de generación, permitiendo a los usuarios especificar atributos o estilos deseados, podría mejorar aún más el potencial creativo de HiDiffusion.

-

Mejoras en escalabilidad y eficiencia: La investigación continua para mejorar la escalabilidad y eficiencia computacional de HiDiffusion podría desbloquear resoluciones aún más altas y tiempos de generación más rápidos, empujando los límites de lo que es posible.

-

Integración con otras tecnologías de IA: Explorar la integración de HiDiffusion con otras tecnologías de IA, como el procesamiento del lenguaje natural o el aprendizaje por refuerzo, podría dar lugar a nuevas aplicaciones y capacidades mejoradas.

A medida que la demanda de contenido visual de alta calidad sigue creciendo, HiDiffusion se presenta como una solución pionera, capacitando a creadores, investigadores y desarrolladores para desbloquear nuevos ámbitos de creatividad y eficiencia en la síntesis de imágenes de alta resolución.

Conclusión

En el siempre cambiante panorama de la IA generativa, HiDiffusion se erige como un testimonio del poder de la innovación y la búsqueda constante de la excelencia. Al combinar técnicas de vanguardia como RAU-Net y MSW-MSA, este marco ha redefinido las posibilidades de la síntesis de imágenes de alta resolución, allanando el camino para nuevas fronteras en creatividad y eficiencia.

Con su capacidad para integrarse sin problemas con modelos de difusión pre-entrenados, HiDiffusion ofrece una solución sin necesidad de ajuste que aborda los desafíos de la duplicación de objetos y el gasto computacional. A través de su arquitectura innovadora y enfoque escalable, HiDiffusion capacita a investigadores, artistas y desarrolladores para desbloquear una creatividad y eficiencia de mayor resolución, permitiendo la generación de imágenes visualmente impresionantes y altamente detalladas con una facilidad sin precedentes.

A medida que el campo de los modelos de difusión continúa evolucionando, HiDiffusion sirve como un faro de inspiración, recordándonos que los límites de lo posible se empujan constantemente y que el futuro ofrece infinitas oportunidades para aquellos dispuestos a abrazar el poder transformador de la tecnología.