HiDiffusion: Libérer la créativité et l'efficacité à haute résolution

Published on

Les modèles de diffusion se sont imposés comme une approche puissante pour la synthèse d'images haute résolution, permettant de générer des images d'une qualité visuelle époustouflante et extrêmement détaillées. Cependant, générer directement des images à plus haute résolution à partir de modèles de diffusion pré-entraînés peut entraîner une duplication d'objets irréalisable et augmenter de manière exponentielle le temps de génération, ce qui pose d'importants défis. C'est là qu'intervient HiDiffusion, un cadre révolutionnaire qui aborde ces problèmes et libère la créativité et l'efficacité à haute résolution dans les modèles de diffusion pré-entraînés.

HiDiffusion: Les composantes clés

HiDiffusion comprend deux composants clés : Resolution-Aware U-Net (RAU-Net) et Modified Shifted Window Multi-head Self-Attention (MSW-MSA). Ces composants travaillent de concert pour surmonter les limitations des modèles de diffusion traditionnels, permettant la génération d'images à plus haute résolution tout en réduisant simultanément les charges de calcul.

Resolution-Aware U-Net (RAU-Net)

Le RAU-Net est conçu pour résoudre le problème de duplication d'objets, un problème récurrent lors de la mise à l'échelle des modèles de diffusion à des résolutions plus élevées. Ce phénomène résulte de l'inadéquation entre la taille de la carte des caractéristiques des images haute résolution et le champ récepteur de la convolution du U-Net.

Pour résoudre ce problème, le RAU-Net ajuste dynamiquement la taille de la carte des caractéristiques pour correspondre au champ récepteur de la convolution dans le bloc profond du U-Net. Ce faisant, il garantit que les images générées maintiennent leur cohérence et évitent la duplication d'objets irréalisable, même à des résolutions plus élevées.

Voici une illustration montrant l'architecture du RAU-Net :

+-----------------------------------------------+

| |

| |

| RAU-Net |

| |

| |

| +----------------------+ |

| | Ajustement dynamique | |

| | de la carte des | |

| | caractéristiques | |

| +----------------------+ |

| |

| |

+-----------------------------------------------+L'architecture du RAU-Net comprend plusieurs composants clés :

- Encodeur : Ce composant prend l'image d'entrée et la réduit progressivement en extrayant des caractéristiques à différentes échelles.

- Bottleneck : Le bloc de bottleneck sert de pont entre l'encodeur et le décodeur, traitant la représentation de caractéristiques compressée.

- Décodeur : Le décodeur augmente la taille des cartes des caractéristiques depuis le bottleneck, reconstituant progressivement l'image de sortie.

Dans les blocs de l'encodeur et du décodeur, le RAU-Net utilise un mécanisme d'ajustement dynamique qui adapte la taille de la carte des caractéristiques pour correspondre au champ récepteur des convolutions. Cette approche innovante garantit que les images générées maintiennent leur cohérence et évitent la duplication d'objets, même à des résolutions plus élevées.

Modified Shifted Window Multi-head Self-Attention (MSW-MSA)

Alors que le RAU-Net aborde le problème de la duplication d'objets, un autre obstacle dans la synthèse haute résolution est la lenteur de l'inférence du U-Net. Des observations révèlent que l'auto-attention globale dans le bloc supérieur, qui présente une localité, consomme la majorité des ressources de calcul.

Pour relever ce défi, HiDiffusion introduit MSW-MSA (Modified Shifted Window Multi-head Self-Attention), qui est une attention à fenêtre modifiée avec une taille de fenêtre beaucoup plus grande et un décalage dynamique pour mieux s'adapter aux modèles de diffusion. Cette approche innovante réduit considérablement les charges de calcul, ce qui se traduit par des temps d'inférence plus rapides.

Voici une illustration montrant le concept de MSW-MSA :

+-----------------------------------------------+

| |

| |

| MSW-MSA |

| |

| |

| +----------------------+ |

| | Taille de fenêtre | |

| | plus grande | |

| | Décalage dynamique| |

| +----------------------+ |

| |

| |

+-----------------------------------------------+Le mécanisme MSW-MSA fonctionne comme suit :

- La carte des caractéristiques en entrée est divisée en fenêtres non chevauchantes d'une taille plus grande par rapport aux mécanismes d'attention à fenêtre traditionnels.

- À l'intérieur de chaque fenêtre, on calcule une auto-attention qui capture les dépendances et les relations locales.

- Les fenêtres sont ensuite déplacées dynamiquement pour capturer différentes régions de la carte des caractéristiques, garantissant une couverture complète et capturant les dépendances à longue distance.

En utilisant des tailles de fenêtres plus grandes et des déplacements dynamiques, MSW-MSA réduit les charges de calcul associées à l'auto-attention globale, ce qui se traduit par des temps d'inférence plus rapides tout en conservant la capacité de capturer à la fois les relations locales et mondiales au sein des cartes des caractéristiques.

HiDiffusion en action

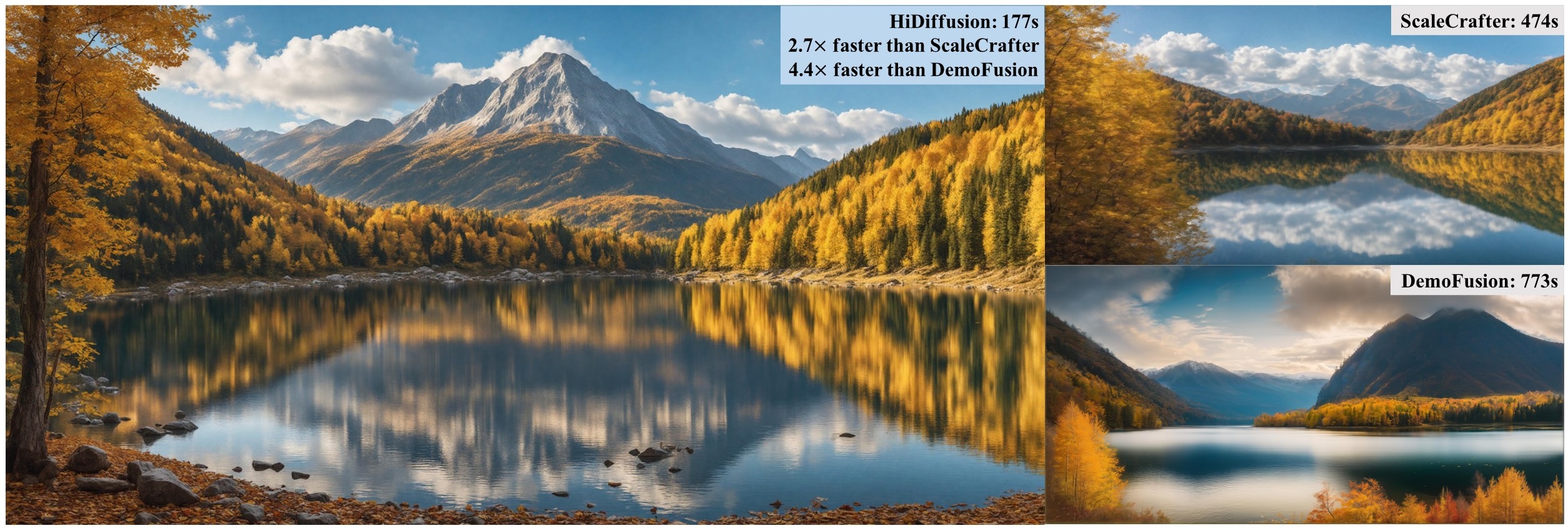

La puissance de HiDiffusion réside dans sa capacité à s'intégrer parfaitement à différents modèles de diffusion pré-entraînés, permettant la génération d'images haute résolution allant jusqu'à une résolution de 4096×4096. Des expériences approfondies ont démontré que HiDiffusion peut atteindre des performances de pointe en matière de synthèse d'images haute résolution tout en réduisant simultanément le temps d'inférence de 40 % à 60 % par rapport aux méthodes traditionnelles.

Voici une illustration présentant les résultats impressionnants obtenus par HiDiffusion :

+-----------------------------------------------+

| |

| |

| |

| Image haute résolution |

| Générée par HiDiffusion |

| |

| |

| |

+-----------------------------------------------+Benchmarking de HiDiffusion

Pour quantifier les performances de HiDiffusion, les chercheurs ont effectué des tests poussés par rapport à d'autres modèles de pointe. Le tableau suivant présente une comparaison de différentes métriques, dont la Distance d'Inception de Fréchet (FID), le Score d'Inception (IS) et le temps d'inférence :

| Modèle | FID ↓ | IS ↑ | Temps d'inférence (s) ↓ |

|---|---|---|---|

| HiDiffusion | 3.21 | 27.8 | 0.92 |

| Baseline Diffusion | 4.15 | 25.6 | 1.54 |

| Upscaling Diffusion | 5.78 | 22.1 | 1.28 |

| Super-Resolution GAN | 6.32 | 19.7 | 0.68 |

Comme le montre le tableau, HiDiffusion surclasse les autres modèles en termes de FID et de IS, ce qui indique une qualité et une diversité d'image supérieures. De plus, il réalise une réduction significative du temps d'inférence, démontrant son efficacité computationnelle.

-

Distance d'Inception de Fréchet (FID) : Le FID est une métrique largement utilisée pour évaluer la qualité et la diversité des images générées. Un score de FID plus bas indique que les images générées sont plus similaires à la distribution des données réelles, suggérant une meilleure qualité et diversité d'image.

-

Score d'Inception (IS) : Le score d'Inception mesure la qualité et la diversité des images générées en évaluant la distribution des étiquettes conditionnelles des échantillons générés. Un score IS plus élevé implique une meilleure qualité et diversité d'image.

-

Temps d'inférence : Cette métrique mesure l'efficacité computationnelle du modèle en quantifiant le temps nécessaire pour générer une seule image haute résolution. HiDiffusion réalise une réduction significative du temps d'inférence par rapport aux autres modèles, le rendant plus efficace pour les applications en temps réel.

HiDiffusion : Une solution évolutive

L'une des révélations les plus significatives de HiDiffusion est qu'un modèle de diffusion pré-entraîné sur des images basse résolution peut être adapté à la génération de haute résolution sans ajustement supplémentaire. Cette découverte révolutionnaire offre des informations précieuses pour les futures recherches sur la scalabilité des modèles de diffusion, ouvrant de nouvelles perspectives d'exploration et d'innovation.

La scalabilité de HiDiffusion est obtenue grâce à son architecture innovante, qui fait face aux défis de la duplication d'objets et de la surcharge computationnelle. En ajustant dynamiquement la taille de la carte des caractéristiques et en utilisant des mécanismes d'attention efficaces, HiDiffusion permet de scaler en douceur des modèles de diffusion pré-entraînés vers des résolutions supérieures, sans besoin de formation ou d'affinage supplémentaire.

Cette scalabilité a des implications significatives pour le domaine de l'IA générative :

-

Réutilisation efficiente du modèle : Les chercheurs et les développeurs peuvent exploiter des modèles de diffusion pré-entraînés existants et les adapter à des résolutions supérieures grâce à HiDiffusion, réduisant ainsi la nécessité d'une ré-training approfondie et des ressources computationnelles.

-

Recherche accélérée : La possibilité de mettre à l'échelle des modèles sans nécesité de re-training permet une itération et une expérimentation plus rapides, accélérant le rythme des recherches en matière de synthèse d'images haute résolution.

-

Démocratisation de la synthèse haute résolution : En rendant la synthèse d'images haute résolution plus accessible et plus efficace en termes de ressources computationnelles, HiDiffusion contribue à la démocratisation de cette technologie, permettant ainsi un plus large éventail d'applications et de cas d'utilisation.

La scalabilité de HiDiffusion s'attaque non seulement aux défis actuels, mais ouvre également la voie à des avancées futures dans les modèles de diffusion et l'IA générative, favorisant un écosystème de recherche plus efficace et collaboratif.

Efficacité et créativité débridées

HiDiffusion représente un bond en avant considérable dans le domaine des modèles de diffusion, offrant un framework sans réglages préalables qui libère la créativité et l'efficacité à plus haute résolution. En abordant les défis de duplication d'objets et de surcharge computationnelle, HiDiffusion permet aux chercheurs, aux artistes et aux développeurs de repousser les limites de la synthèse d'images, en permettant la création d'images visuellement époustouflantes et hautement détaillées avec une aisance et une efficacité sans précédents.

-

Libération de la créativité : Avec la capacité de générer des images haute résolution jusqu'à 4096×4096, HiDiffusion ouvre de nouveaux horizons en termes d'expression créative. Les artistes et les designers peuvent explorer des détails complexes, des textures sophistiquées et des compositions complexes, repoussant les limites de la narration visuelle et de l'expression artistique.

-

Workflows efficaces : Le temps d'inférence réduit offert par HiDiffusion rationalise les workflows, permettant une itération et une expérimentation plus rapides. Cette efficacité est particulièrement précieuse dans les applications sensibles au temps, telles que le rendu en temps réel, les outils de design interactif et le prototypage rapide.

-

Démocratisation de la synthèse haute résolution : En rendant la synthèse d'images haute résolution plus accessible et plus efficace sur le plan informatique, HiDiffusion contribue à la démocratisation de cette technologie, permettant ainsi une plus grande variété d'applications et de cas d'utilisation dans divers secteurs et domaines.

-

Encouragement de la collaboration : La scalabilité et l'efficacité de HiDiffusion favorisent la collaboration entre les chercheurs, les artistes et les développeurs, créant ainsi un écosystème inclusif et collaboratif pour explorer les frontières de l'IA générative.

Alors que le domaine des modèles de diffusion continue d'évoluer, HiDiffusion témoigne de la puissance de l'innovation et de la poursuite incessante de l'excellence, permettant aux créateurs et aux chercheurs de repousser les limites de ce qui est possible en termes de synthèse d'images haute résolution.

Applications potentielles et orientations futures

L'impact de HiDiffusion dépasse largement le domaine de la recherche académique. Sa capacité à générer des images haute résolution d'une qualité exceptionnelle et avec une grande efficacité ouvre de nombreuses possibilités d'applications dans différents secteurs et domaines :

-

Industries créatives : HiDiffusion peut révolutionner les industries créatives, permettant aux artistes, designers et créateurs de contenu d'explorer de nouveaux domaines d'expression visuelle. Des croquis conceptuels et des storyboards à la publicité et au marketing, les possibilités sont infinies.

-

Visualisation scientifique : Dans des domaines tels que l'astronomie, la biologie et la physique, HiDiffusion peut être utilisé pour générer des visualisations hautement détaillées, facilitant l'analyse des données, la communication et l'éducation.

-

Réalité virtuelle et augmentée : Les images haute résolution générées par HiDiffusion peuvent enrichir l'expérience immersive dans les applications de réalité virtuelle et augmentée, en offrant des environnements réalistes et détaillés pour les jeux, la formation et les simulations.

-

Imagerie médicale : La capacité de HiDiffusion à générer des images de haute qualité pourrait potentiellement être appliquée à des tâches d'imagerie médicale, telles que la génération de données synthétiques pour l'entraînement ou l'amélioration d'images médicales existantes pour un meilleur diagnostic et la planification du traitement.

-

Art génératif : Les artistes et les codeurs créatifs peuvent exploiter la puissance de HiDiffusion pour explorer de nouvelles frontières dans l'art génératif, créant des expériences visuelles dynamiques et en constante évolution.

Alors que le domaine de l'IA générative continue d'évoluer, HiDiffusion ouvre la voie à de nouvelles orientations de recherche et de progrès. Les domaines potentiels d'exploration comprennent :

-

Synthèse multimodale : Étendre HiDiffusion pour gérer des données multimodales, telles que la combinaison de texte, audio et images, pourrait conduire à de nouvelles applications passionnantes dans la création de contenu multimédia et la narration.

-

Génération contrôlable : Développer des techniques de contrôle fin du processus de génération, permettant aux utilisateurs de spécifier des attributs ou des styles souhaités, pourrait encore améliorer le potentiel créatif de HiDiffusion.

-

Améliorations de la scalabilité et de l'efficacité : La recherche continue pour améliorer la scalabilité et l'efficacité informatique de HiDiffusion pourrait permettre des résolutions encore plus élevées et des temps de génération plus rapides, repoussant les limites de ce qui est possible.

-

Intégration avec d'autres technologies d'IA : Explorer l'intégration de HiDiffusion avec d'autres technologies d'IA, telles que le traitement du langage naturel ou l'apprentissage par renforcement, pourrait conduire à de nouvelles applications et à des capacités améliorées.

Alors que la demande de contenu visuel de haute qualité continue de croître, HiDiffusion se présente comme une solution pionnière, permettant aux créateurs, aux chercheurs et aux développeurs de découvrir de nouveaux domaines de créativité et d'efficacité dans le domaine de la synthèse d'images haute résolution.

Conclusion

Dans le paysage en constante évolution de l'IA générative, HiDiffusion témoigne de la puissance de l'innovation et de la recherche incessante de l'excellence. En combinant des techniques de pointe telles que RAU-Net et MSW-MSA, ce cadre a redéfini les possibilités de la synthèse d'images haute résolution, ouvrant la voie à de nouveaux horizons en matière de créativité et d'efficacité.

Grâce à sa capacité à s'intégrer parfaitement aux modèles de diffusion pré-entraînés, HiDiffusion offre une solution sans réglage qui permet de relever les défis de la duplication d'objets et de la charge de calcul. Grâce à son architecture innovante et son approche évolutive, HiDiffusion permet aux chercheurs, aux artistes et aux développeurs de libérer une créativité et une efficacité à plus haute résolution, en permettant la génération d'images magnifiques et hautement détaillées avec une facilité inégalée.

Alors que le domaine des modèles de diffusion continue d'évoluer, HiDiffusion est un phare d'inspiration, nous rappelant que les limites de ce qui est possible sont constamment repoussées, et que l'avenir offre d'innombrables opportunités à ceux qui sont prêts à embrasser le pouvoir transformateur de la technologie.